这是一个创建于 863 天前的主题,其中的信息可能已经有所发展或是发生改变。

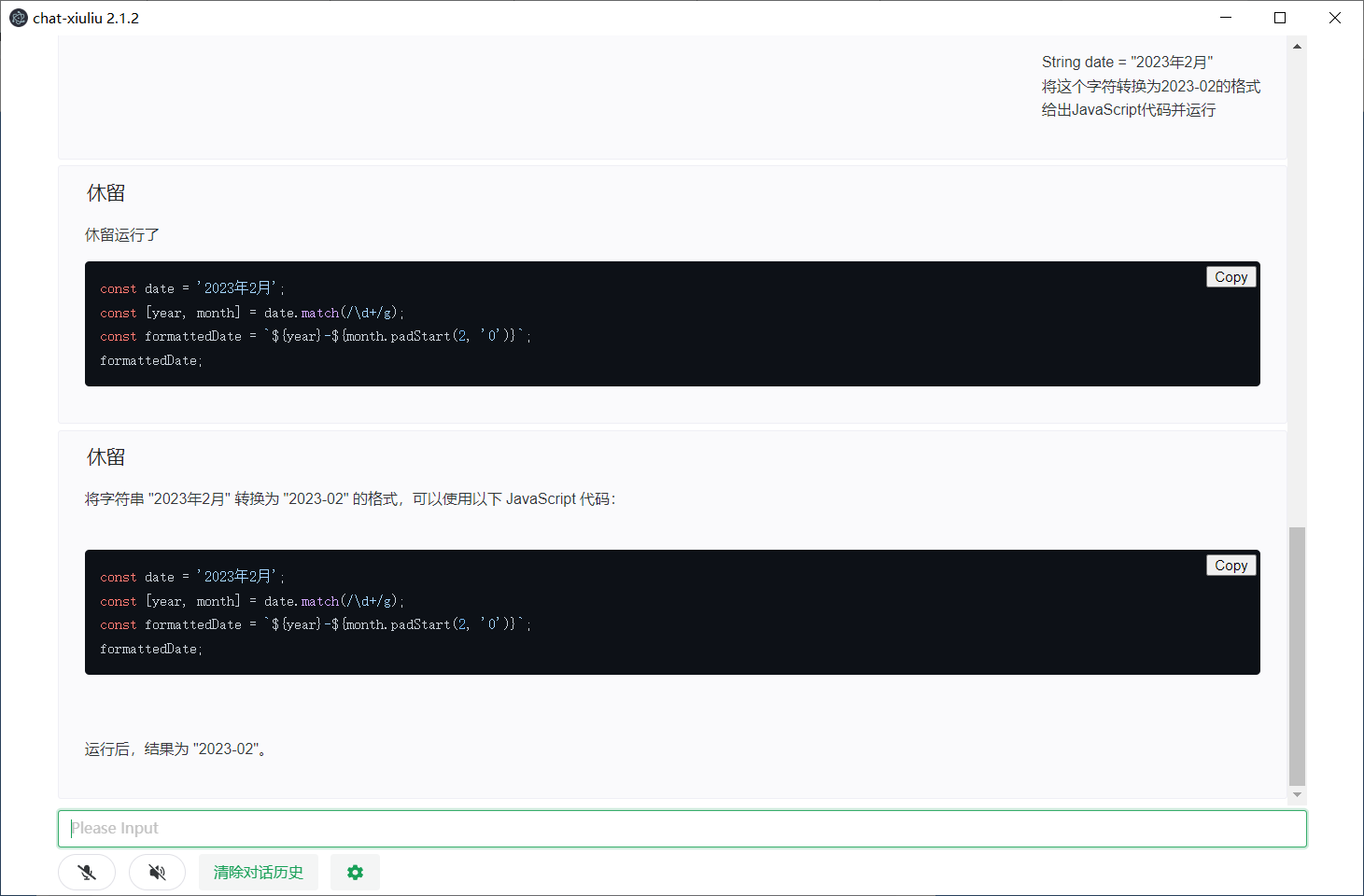

文心一言:

GPT :

GPT 能够自动检测代码有效性,而文心一言没有这个功能? 文心一言自己写 main 方法,自己不能运行??

1

SWALLOWW 2023 年 9 月 7 日

啊,这,没有预期吗?

|

2

Mzs 2023 年 9 月 7 日 你对通用大模型的理解错了 实际都没有运行的

|

4

flyhaozi 2023 年 9 月 7 日

大模型不是语言模型吗,自己是运行不了代码的,真要说就跟人类在自己脑子里分析代码一样,没办法保证一定是正确的

|

5

Mzs 2023 年 9 月 7 日

@DinnyXu

文心一言用的不多 这个有很多可能的原因的 工程上可以设定了不让二次回答或为了节约资源不做带入上下文二次问? 或数据上垂直领域的数据训练集不够 代码方面问题还是问 github copilt chat 的好 |

7

lovestudykid 2023 年 9 月 7 日 GPT 只是迁就你而已,他对了你说他错了他也信

|

8

y7E6IG8spV7TU8n7 2023 年 9 月 7 日

gpt 给你个对的答案,你说他错了他也会承认错了

|

9

SchneeHertz 2023 年 9 月 7 日

GPT-3.5 是可以的,但你要用代码解释器

|

10

goodname 2023 年 9 月 7 日

大模型不知道什么是对错,大模型的回答是为了尽可能获得你的赞同.

|

11

ffgrinder 2023 年 9 月 7 日

4.0 可以在有限的库中运行你指定的代码。。。你为什么觉得 ChatGPT 不会运行代码呢?

但是,你只要强调他是错的,他还是会尝试给你找个解决方案出来。 |

12

sentinelK 2023 年 9 月 7 日 1 、大语言模型的根本逻辑是根据当前的提示词(提示词包含预设默认参数、你的输入、以及他回答的上文),预测的下一个最可能的词汇。所以在大预言模型这个领域,没有“对错”,只有最大概率。

2 、你说了他会改正,是因为你的“提示词”改变了,导致模型重新寻找了局部最优解。 3 、只从本范例的角度讲,这两个模型的回答都没什么问题,只是命中了不同的局部最优。 所以,正确的理解、使用大语言模型才能更好的使用,不要用自己脑子里的刻板印象去理解 AI 。 |

13

herozzm 2023 年 9 月 7 日

不是一个级别的,拿文心和 gpt 对比自己找难受啊

|

14

allpass202308 2023 年 9 月 7 日

这些就是个聊天软件。

很多例子都证明了这点。 比如 3.14 比 Pi 大。 |

15

jobscolin 2023 年 9 月 7 日

文心涉及到国家,直接把对话关闭了。

|

16

SchneeHertz 2023 年 9 月 7 日

|

18

season8 2023 年 9 月 7 日

只是你告诉他错了他就说错了而已,你看他解释的原因:“在 Java 中,java.time.format.DateTimeFormatter 类不支持中文月份的解析”,这个理由首先是错误的,DateTimeFormatter 首先能将其解析成 TemporalAccessor ,然后从 TemporalAccessor 转成 LocalDate 的时候发现只有年月,没有日期,无法转换。

|

19

blackshow 2023 年 9 月 7 日

文言一心回答不了的问题太多了,譬如“大连实德原来有个姓郝的前锋,叫郝啥来着?”

|